智能汽车是汽车、电子、信息通信、道路交通运输等行业深度融合的新型产业形态。当前, 我国智能汽车产业进入快车道, 技术创新日益活跃, 新型应用蓬勃发展, 产业规模不断扩大,而相应的测试技术体系也在不断完善, 推动产业进步。本书首先立足于整体现状对智能汽车测试体系架构进行综述, 并针对测试技术的发展趋势和整个核心技术进行详细描述;然后, 针对测试体系中每一测试过程的概念、核心思想、关键技术、测试方法、发展趋势等进行详细描述。

本书可供智能汽车设计人员及测试人员阅读使用, 也可供车辆工程专业及相关专业师生阅读参考。

本文是《智能汽车测试技术》系列文章第三篇,上两篇:

智能汽车测试技术:环境感知系统的测试技术与方法(二、测试技术框架及各类感知环境介绍)

智能汽车测试技术:环境感知系统的测试技术与方法(一、需求分析及系统介绍)

注:本文节选自《智能汽车测试技术》,由机械工业出版社于2025年6月份出版

《智能汽车测试技术》目录

第1 章

导论

1.1 背景与需求/ 001

1.2 基本概念/ 003

1.2.1 测试与评价的基本概念/ 003

1.2.2 产品全生命周期中的测评技术/ 004

1.3 现状与挑战/ 005

1.4 本书章节安排/ 006

第2 章

智能汽车

测评概述

2.1 测评需求分析/ 009

2.1.1 安全性测试与验证/ 009

2.1.2 智能性测试与评价/ 012

2.2 测试方法论/ 015

2.2.1 安全性测试验证框架/ 015

2.2.2 智能性测试评估框架和体系/ 017

2.3 测试工具链及应用要求/ 023

2.3.1 测试工具链/ 023

2.3.2 测试需求与测试工具的适配性/ 027

2.4 本章小结/ 029

参考文献/ 030

第3 章

智能汽车

测试场景

3.1 场景基本概念/ 031

3.2 场景体系/ 033

3.2.1 场景要素与属性/ 033

3.2.2 场景层级/ 035

3.2.3 场景分类/ 036

3.3 场景生成方法/ 037

3.3.1 基于形式化描述的场景生成方法/ 037

3.3.2 基于驾驶员模型的场景生成方法/ 040

3.3.3 安全关键场景生成方法/ 048

3.4 场景采集与利用/ 051

3.4.1 场景采集技术/ 051

3.4.2 场景库搭建/ 052

3.5 本章小结/ 052

参考文献/ 053

第4 章

环境感知

系统的测试

技术与方法

4.1 环境感知系统测试需求分析/ 055

4.2 环境感知系统介绍/ 057

4.2.1 感知系统/ 057

4.2.2 硬件模组/ 058

4.2.3 认知算法/ 058

4.3 环境感知系统测试技术框架/ 059

4.4 各类感知环境介绍/ 060

4.4.1 封闭场地环境/ 060

4.4.2 道路交通环境/ 064

4.4.3 虚拟仿真环境/ 066

4.5 数据生成模型介绍/ 069

4.5.1 降雨图像生成方法概述/ 070

4.5.2 降雨图像生成模型介绍/ 071

4.5.3 降雨图像生成模型结果/ 075

4.6 具体测试案例/ 076

4.6.1 案例一:基于封闭场地环境的感知系统测试/ 076

4.6.2 案例二:基于虚拟仿真环境的硬件模组测试/ 078

4.6.3 案例三:基于虚拟仿真环境的感知系统测试/ 081

4.6.4 案例四:基于三类感知环境和数据生成模型的

认知算法测试/ 083

4.7 本章小结/ 086

参考文献/ 087

第5 章

决策规划

系统的测试

技术与方法

5.1 决策规划系统的测试需求与挑战/ 089

5.1.1 测试需求/ 089

5.1.2 测试挑战/ 090

5.2 基于场景的测试技术与方法/ 092

5.2.1 静态试验设计测试方法/ 092

5.2.2 动态试验设计测试方法/ 094

5.3 基于真实里程的测试技术与方法/ 101

5.3.1 开放道路测试技术/ 101

5.3.2 重要度采样加速测试方法/ 103

5.4 基于虚拟里程的测试技术与方法/ 104

5.4.1 虚拟里程测试系统组成框架/ 105

5.4.2 用于虚拟里程测试的NPC 模型生成方法/ 106

5.4.3 用于虚拟里程测试的NPC 模型性能验证/ 113

5.4.4 虚拟里程测试的应用/ 118

5.4.5 小结/ 130

5.5 其他测试技术/ 131

5.5.1 自动化测试技术/ 131

5.5.2 错误注入测试技术/ 139

5.5.3 分布式自动化测试技术/ 152

5.6 本章小结/ 157

参考文献/ 157

第6 章

整车测试

技术与方法

6.1 整车测评需求分析/ 159

6.2 封闭测试场地平台/ 160

6.2.1 封闭测试场/ 160

6.2.2 动态模拟目标物系统/ 162

6.2.3 定位与数据采集系统/ 163

6.3 开放道路测试系统/ 164

6.3.1 测试方案制定/ 165

6.3.2 数据采集与数据闭环系统/ 165

6.4 本章小结/ 166

第7 章

智能汽车

安全性评估

7.1 基于具体场景的安全性评估/ 169

7.1.1 场景瞬时风险评估方法/ 170

7.1.2 多阶段安全评估/ 180

7.1.3 单个测试场景结果外推/ 181

7.2 基于逻辑场景的安全性评估/ 182

7.2.1 评估要求/ 182

7.2.2 面向逻辑场景评价的危险域识别方法/ 183

7.3 针对被测功能的安全性评估/ 192

7.4 本章小结/ 192

参考文献/ 193

第8 章

智能汽车

综合行驶

性能评估

8.1 测评需求与研究现状/ 195

8.1.1 测评需求/ 195

8.1.2 研究现状/ 195

8.2 测评基本流程/ 197

8.3 典型测试场景矩阵/ 198

8.4 测试方法与流程/ 199

8.4.1 测试方案/ 199

8.4.2 背景车跟驰模型/ 199

8.4.3 测试数据输出/ 201

8.5 评价方法与流程/ 202

8.5.1 评价体系/ 202

8.5.2 评价流程/ 204

8.6 测评示例/ 206

8.7 本章小结/ 209

参考文献/ 209

附 录

附录A 测试工况参数设置/ 210

附录B 背景车跟驰模型/ 212

附录C 归一化方法/ 214

附录D 常见缩写词/ 216

4. 5 数据生成模型介绍

在4.3 节介绍的环境感知系统测试技术框架中, 数据生成模型(如图像生成模型、大语言模型等) 无须从某一个感知环境出发, 就可以直接有针对性地生成大量、拟真的感知数据, 近年来有很多学者致力于此。而基于数据生成模型得到的待测数据直接影响后续的测试, 因此, 这一数据生成方法对模型的精度提出了较高的要求。

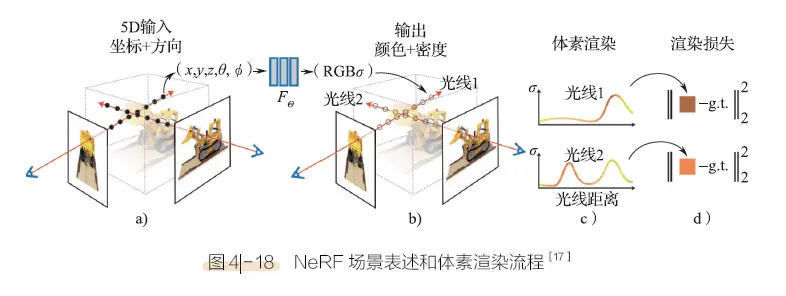

近年来, 神经辐射场(Neural Radiance Fields, NeRF)技术的兴起为数据生成提供了新的可能性。NeRF 于2020年被首次提出[17] , 它是一种基于隐式辐射场的技术, 通过使用多视角的2D 图像及相应摄像头姿态来训练神经网络重建3D 场景, 用以提取新视角的图像。NeRF 的核心原理类似于光线追踪技术, 其主要过程是通过多层感知器(Multi Layer Perceptron, MLP)对给定的空间坐标(x, y,z) 和观察方向(θ, ϕ) 进行光线路径建模, 计算得到该点的颜色和密度值, 如图4 -18 所示。基于该技术不仅能够实现高保真图像的生成, 还能够从不同的视角自由提取图像, 甚至能够对场景中的动态目标进行修改和重建。NeRF 训练渲染流程可以总结如下:

1) 对于给定的摄像头光线, 在光线上进行采样, 对采样点的空间坐标及观察方向进行编码, 用深度复杂网络获得辐射场信息。

2) 辐射场输出空间点的颜色和密度。

3) 根据2) 的输出, 用体素渲染方程获得生成视角图片。

4) 在训练阶段, 根据原视角图片计算损失更新网络。

基于NeRF技术,TancikM等[18] 提出了Block⁃NeRF,将场景分解为单独训练的NeRF,实现了对街景的大规模渲染。在此基础上,UniSim[19] 提出了一种扩展的NeRF,将场景解构为动态目标和静态背景,如图4-19所示,通过动态目标姿态估计建立空间之间的映射,以实现对动态目标的创建和编辑,包括对象的移除、增添和动作修改等,能够有效支持自动驾驶闭环仿真,但仍存在渲染计算负载高的问题。

图4-19 UniSim基于原始传感数据创建可编辑的数字孪生,实现对场景中对象的移除、增添、动作修改等操作[19]

另外,基于GAN方法搭建的数据生成模型也是常用的数据生成方法,已经发展较为成熟,下面将以模拟降雨图像生成为例,介绍现有图像生成方法,并选取其中一种进行详解。

4.5.1 降雨图像生成方法概述

模拟降雨图像生成方法主要分为三种。

1)基于物理模型的图像生成:通过研究雨滴的物理模型,[20] 获取降雨对图像的影响,进而实现从晴天图像生成雨天图像。如图4-20所示,首先基于估计的场景深度,生成一个雾状的衰减层。然后,生成雨条纹和雨滴,并与雾状层合成。最后,将生成结果与原始图像叠加在一起,得到基于物理模型的降雨图像生成。

图4-20 基于物理模型的降雨图像生成

2)基于深度学习的图像生成:基于神经网络构建降雨图像生成模型,由数据驱动获取降雨图像。基于物理的渲染可以产生真实的雨条纹和雾状的雨效果,但它忽略了主要的降雨特征,如湿度、反射、云,因此可能无法传达下雨场景的整体外观,而神经网络则擅长学习这些视觉特征。下一小节将以其中一个图像生成模型为例,详细介绍基于深度学习的降雨图像生成模型的原理。

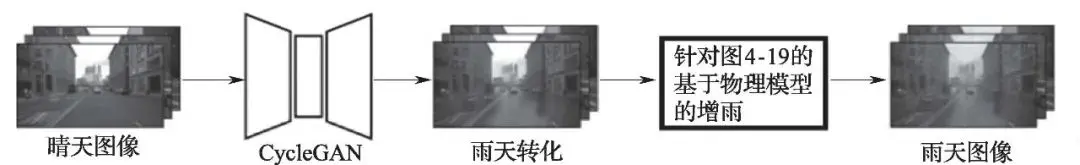

3)基于物理模型和深度学习结合的图像生成:如图4-21所示,首先使用深度学习模型将晴天图像转换为雨天图像,再使用基于物理模型的方法增强雨条纹[21] 。

图4 -21 基于物理模型和深度学习结合的图像生成

4.5.2 降雨图像生成模型介绍

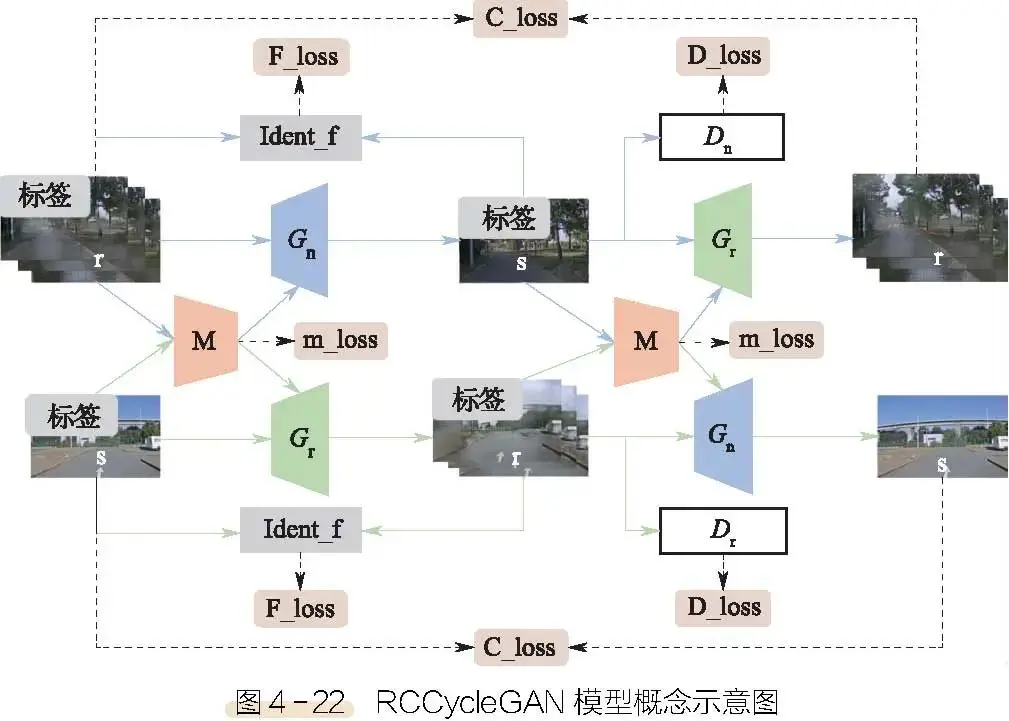

本节将介绍一个基于GAN[22] 的小、中、大雨三级降雨图像生成模型(RainConditionalCycleGAN,RCCycleGAN)[23] 。

GAN于2014年被提出,其由生成网络和判别网络相互对抗组成。生成网络负责从训练数据中学习期望输出数据分布,由原始输入生成模拟数据;判别网络则是负责判断输入数据属于模拟数据还是真实数据。在对抗过程中,生成网络旨在得到判别网络无法区分的模拟数据,而判别网络旨在尽可能区分模拟数据与真实数据,生成网络与判别网络按照动态博弈规则进行训练。条件生成对抗网络(ConditionalGenerativeAdversarialNetworks,CGAN)于2014年被提出[24] ,实现生成对抗网络一对多的映射输出。该模型引入了传统深度学习中的监督式学习思想,在原有生成网络和判别网络上引入辅助信息y(数据标签),使得生成网络可以生成具有辅助指导的模拟数据。循环对抗生成网络(Cycle⁃ConsistentGenerativeAdversarialNetworks,CycleGAN)[21] 于2017年被提出,实现非配对图像间端到端的学习,该模型被广泛应用于两个数据集合之间的风格迁移。下面要详细介绍的模型RCCycleGAN,则是在CycleGAN的基础上进行修改的,其概念示意图如图4-22所示。该模型主要由以下4个模块构成:

1)判别网络Dn 与Dr: 其输入为真实图像或模拟图像与对应的降雨强度标签, Dn 用于判别输入图像属于真实晴天图像还是模拟晴天图像, Dr 用于判别输入图像属于真实降雨图像还是模拟降雨图像。

2)生成网络Gn 与Gr:其输入为真实图像或模拟图像、降雨掩膜和对应的降雨强度标签,Gn 用于由多级降雨图像(包括真实降雨图像与模拟降雨图像)生成模拟晴天图像,Gr 用于由晴天图像(包括真实晴天图像和模拟晴天图像)生成模拟多级降雨图像。

3)降雨掩膜识别网络Ident_m:用于获取降雨图像与真实图像的雨量掩膜,属于一种非监督的降雨掩膜识别模块。

4)图像特征识别网络Ident_f:用于获取模拟图像与真实图像的关键特征,采用已训练的深度卷积网络。

图4 -22 RCCycleGAN 模型概念示意图

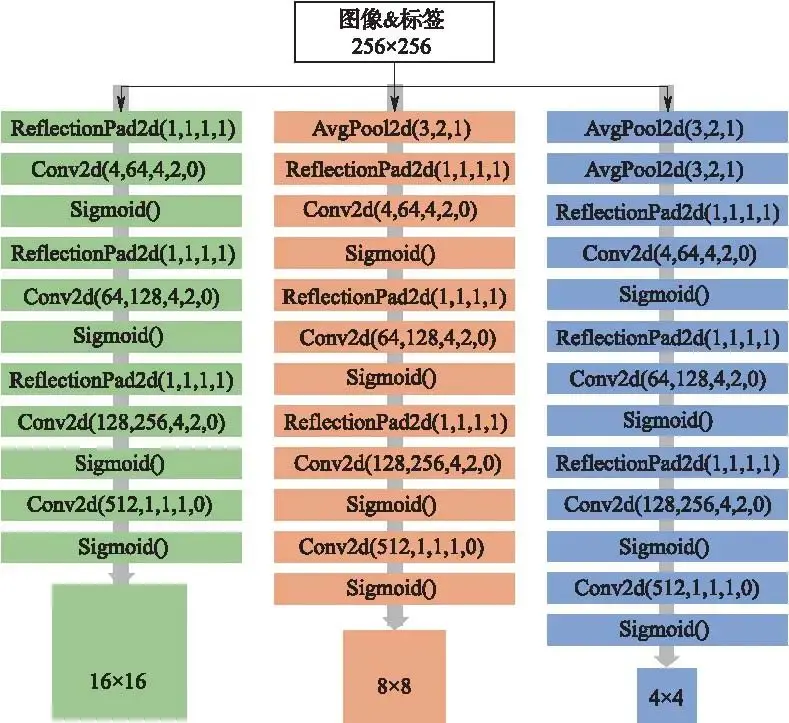

(1)判别网络

判别网络Dn 与Dr 采用了相同的多尺度卷积网络。输入为模拟图像或真实图像(RGB3通道)及对应的降雨强度标签(1通道),其中降雨强度标签实现条件生成对抗网络,并采用PathGAN结构作为判别网络最终输出,相较于传统采用全连接层作为判别网络最终输出,PathGAN结构最终输出为局部感受野,可保留更多图像特征,更好地指导生成网络输出模拟数据。判别网络架构如图4-23所示,其由三个深度卷积神经网络构成,不同尺度通过平均池化层得到。各卷积层通过卷积核提取感受野内特征,通过多层卷积网络提取输入图像的特征及结构信息。

图4 -23 判别网络架构

(2)生成网络

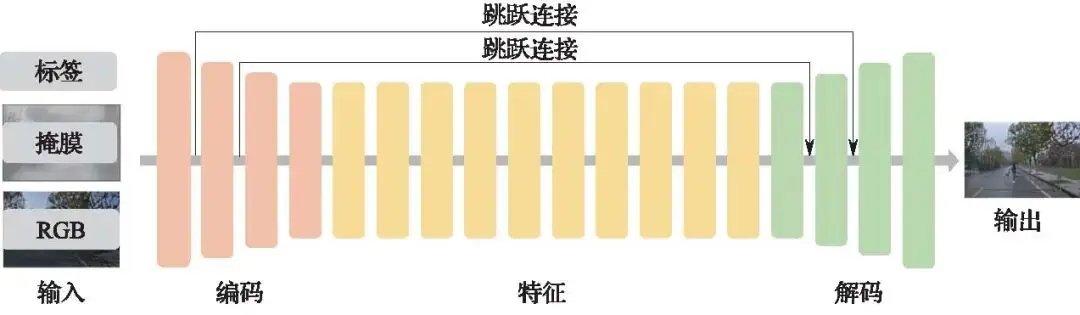

生成网络Gn 与Gr 采用了相同的U⁃net结构,其网络结构示意图如图4-24所示。生成网络输入(5通道)包括原始图像(RGB3通道)、降雨强度标签(1通道)和降雨掩膜(灰度图1通道)三部分,其中降雨强度标签实现条件生成对抗网络。生成网络主要由编码器、转换器和解码器构成。编码器由4层卷积神经网络构成,完成对输入信息的特征提取,获取更优的全局信息。而后转换器由10层卷积神经网络构成,实现降雨/除雨风格迁移。解码器由三层卷积神经网络构成,对风格迁移后的图像特征进行解码,输出模拟图像。

图4-24 生成网络结构示意图

(3)降雨掩膜识别网络

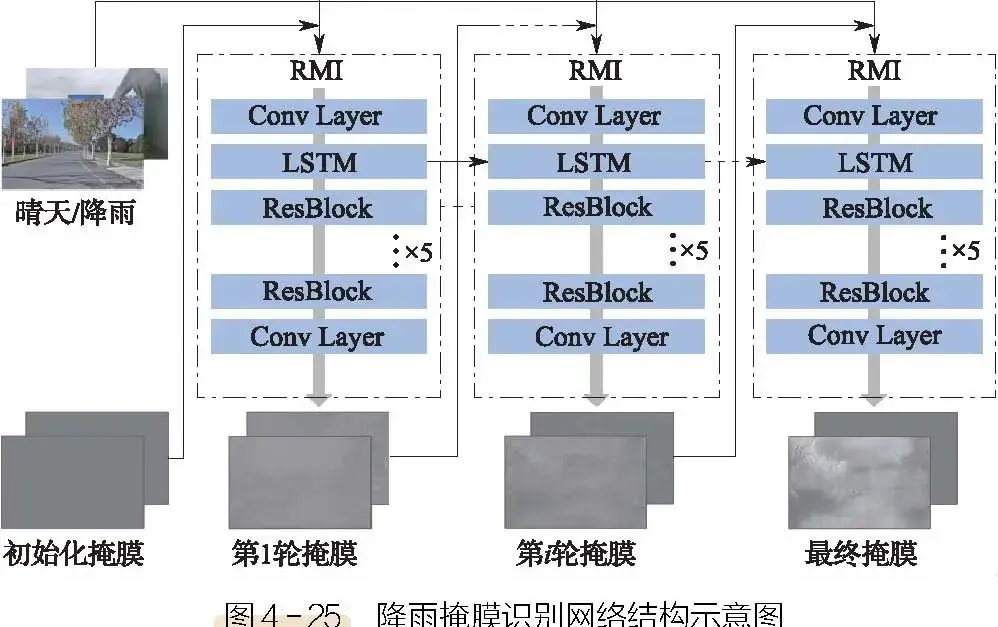

针对晴天图像到降雨图像的转换任务,传统的CycleGAN通过判别网络自主捕捉两个数据集合(晴天/降雨)之间的差异,而后根据判别网络输出指导生成网络获取较为真实的模拟降雨图像。但降雨图像由背景信息及降雨信息(雨滴条纹和视觉传感器表面遮挡)两部分构成,其中的降雨信息,即降雨掩膜,由雨滴遮挡和雨滴条纹两部分组成。因此,若仅依靠CycleGAN模型来完成该任务,由于晴天图像与降雨图像所包含的信息并不对称,则需要大量数据与训练时间。在数据缺乏和训练不足的情况下,CycleGAN模型会出现颜色或结构破坏的问题。为解决上述问题,设计了降雨掩膜识别网络,其网络结构示意图如图4-25所示,通过降雨图像和晴天图像两个支路共同约束降雨掩膜识别过程。

图4 -25 降雨掩膜识别网络结构示意图

降雨掩膜识别网络由若干降雨掩膜识别模块(RainMaskIdentification,RMI)构成,每个RMI由卷积层和激活层、LSTM、若干残差模块和卷积层构成。首先,由卷积层和激活层对输入的图像和上一轮输出的降雨掩膜进行特征提取。然后,利用LSTM模块结合上一轮输出更新降雨掩膜。此外,随着RMI模块数量的增加,降雨掩膜识别网络的层数会急剧增加,导致网络训练过程中出现梯度消失的问题。因此,RMI模块引入了5个残差模块,使得降雨掩膜识别网络具有较大的深度且具备较大的感受野。最后,利用卷积层获取单通道的降雨信息(即掩膜)。

(4)图像特征识别网络

图像特征识别网络为一个已训练稳定的VGG16网络,其负责提取真实图像与模拟图像包含的特征与结构信息,后续无须训练。由先验知识可知,生成网络输出的模拟降雨图像在真实图像上叠加了降雨掩膜,总体来说,图像的特征和结构信息并未发生较大改变。

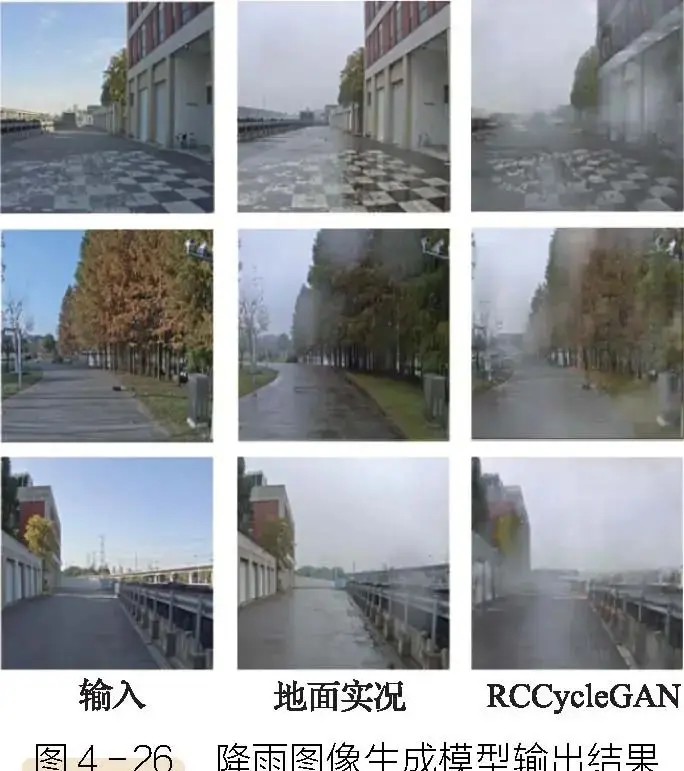

4.5.3 降雨图像生成模型结果

经过一定轮次的训练后,该模拟降雨图像生成模型输出结果如图4-26所示。其中,左侧第一列为输入晴天图像,第二列为真实小雨图像,第三列为RCCycleGAN生成的模拟小雨图像。可以看出,RCCycleGAN可以较好地保留图像结构信息,减少图像扭曲现象,同时保留较多色彩信息,保留图像内的局部细节(阴影、反光等),与真实驾驶场景接近。因此,基于该生成模型输出的图像数据,可以满足下一步测试的需求。

图4 -26 降雨图像生成模型输出结果

本书首先立足于整体现状对智能汽车测试体系架构进行综述, 并针对测试技术的发展趋势和整个核心技术进行详细描述;然后, 针对测试体系中每一测试过程的概念、核心思想、关键技术、测试方法、发展趋势等进行详细描述。

本书可供智能汽车设计人员及测试人员阅读使用, 也可供车辆工程专业及相关专业师生阅读参考。

作者简介:

陈君毅,2009年毕业于同济大学汽车学院,获工学博士学位,任职于同济大学汽车学院。长期从事自动驾驶汽车测试与评价方向研究工作,先后主持和参与国家级、省部级项目共11项,并与华为、路特斯、上汽大众、蔚来等企业开展了深度校企合作研究。近5年,在国内外学术期刊和国际会议上共发表SCI/EI检索论文近30篇,其中以第一作者或及通讯作者发表的为20余篇;申请发明专利30余项(已授权7项)。担任SAE汽车安全和网络安全技术委员会秘书、功能安全和预期功能安全分委会主席;是自动驾驶测试场景国际标准(ISO3450X)支撑专家组成员,以及CAICV联盟预期功能安全工作组核心成员;担任《汽车工程》和《汽车工程学报》青年编委委员,IEEE Transactions on Intelligent Vehicles、Proceedings of the Institution of Mechanical Engineers, Part D: Journal of Automobile Engineering、《中国公路学报》、《汽车工程》、IEEE Intelligent Transportation Systems Conference、IEEE Intelligent Vehicles Symposium等国内外期刊和国际会议审稿人,曾于多项国际学术会议担任分论坛主席。

版权信息:

智能汽车测试技术 / 陈君毅等著. -- 北京 : 机械工业出版社, 2025. 5. -- (智能汽车关键技术丛书).ISBN 978-7-111-77871-4 Ⅰ. U467 中国国家版本馆CIP数据核字第2025X8D229号

本书由机械工业出版社出版,本文经出版方授权发布。

来源:汽车测试网